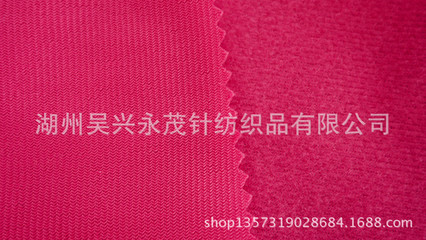

廠家直銷 質量保證 全滌圈絨布 湖州吳興永茂針紡織品的專業針織面料優勢

在當今快節奏的紡織市場中,湖州吳興永茂針紡織品有限公司憑借其廠家直銷的優勢,為用戶提供高質量的全滌圈絨布針織面料。作為一家專注于日用百貨領域的專業制造商,我們堅持以客戶需求為導向,確保產品在價格、質量和設計上均達到行業領先水平。

全滌圈絨布作為一種常見的針織面料,以其柔軟的手感、出色的保暖性能和耐用性而備受青睞。我們的產品采用優質全滌纖維制成,經過精細的圈絨工藝處理,表面絨毛均勻密集,不僅觸感舒適,還具備良好的抗皺性和易護理特性,適用于服裝、家居用品及各類日用百貨領域。在價格方面,由于我們采取廠家直銷模式,省去中間環節,為客戶提供極具競爭力的批發價,讓您以更低的成本獲得高端面料。

湖州吳興永茂針紡織品擁有現代化的生產線和嚴格的質量控制體系,從原材料采購到成品出廠,每一環節都經過層層檢驗,確保每一米面料都符合國際標準。我們還提供豐富的花色和規格選擇,支持定制服務,滿足不同客戶的多樣化需求。通過訪問我們的官方網站或聯系客服,您可以查看詳細的產品圖片和樣品,直觀感受面料的質感與色彩。

選擇湖州吳興永茂針紡織品,您不僅獲得優質的全滌圈絨布,還能享受專業的服務和可靠的售后保障。我們致力于成為您最信賴的針織面料合作伙伴,共創雙贏未來。

如若轉載,請注明出處:http://m.tjil.com.cn/product/46.html

更新時間:2026-04-14 07:49:39